▲ 자갈길을 걷는 4족 보행 로봇(사진=UC샌디에이고)

UC 샌디에이고 연구팀이 4족 보행 로봇의 3D 비전 능력을 획기적으로 제고할 수 있는 훈련 모델을 개발했다고 12일(현지 시각) 밝혔다.

이 모델을 로봇 훈련에 적용하면 4족 로봇이 계단, 울퉁불퉁한 바위가 많은 지면, 틈새가 벌어진 길 등 험한 지형을 자율적으로 횡단할 수 있다.

연구팀은 이달 18일부터 22일까지 캐나다 벤쿠버에서 열리는 컨퍼런스인 ‘2023 컴퓨터 비전 및 패턴인식 컨퍼런스(2023 CVPR : Conference on Computer Vision and Pattern Recognition)’에서 발표할 예정이다. 논문 제목은 “Neural Volumetric Memory for Visual Locomotion Control.”이다.

샤오롱 왕 UC 샌디에이고 교수는 “4족 로봇이 주변 환경을 3D로 보다 더 잘 이해한다면 로봇을 더 복잡한 실제 세계에 배치할 수 있다”고 말했다.

이 로봇의 머리에는 전방을 향해 심도 카메라가 장착되어 있다. 카메라는 전면의 시야와 아래 지형을 모두 잘 볼 수 있도록 아래쪽으로 기울어져 있다.

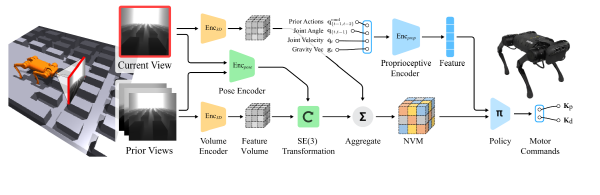

연구팀은 로봇의 3D 인식을 개선하기 위해 카메라로부터 2D 이미지를 가져와 3D 공간으로 변환하는 모델을 개발했다. 현재 프레임과 몇 개의 이전 프레임으로 구성된 짧은 비디오 시퀀스를 확인한 다음, 각각의 2D 프레임에서 3D 정보 조각을 추출해낸다.

여기에는 관절 각도, 관절 속도, 지면으로부터의 거리 등 로봇의 다리 움직임에 대한 정보가 포함돼 있다. 이 모델은 이전 프레임 정보와 현재 프레임 정보를 비교하고, 과거와 현재 사이의 3D 변환을 추정한다. 이 모델은 모든 정보를 결합하여 현재 프레임을 사용하고, 이전 프레임을 합성할 수 있다. 모델은 로봇이 이동할 때 합성된 프레임을 카메라가 이미 캡처한 프레임과 비교 및 확인한다.

이 새로운 연구는 컴퓨터 비전과 고유한 인식(움직임, 방향, 속도, 위치 및 촉각)을 결합해 4족 보행 로봇이 장애물을 피하면서 울퉁불퉁한 지면 위를 걷고 달릴 수 있는 알고리즘을 개발한 팀의 이전 연구를 기반으로 이뤄졌다.

하지만 연구팀은 현재 개발된 모델이 로봇을 특정 목표나 목적지로 안내하지 않는다고 밝혔다.

장길수 ksjang@irobotnews.com

<저작권자 © 로봇신문사 무단전재 및 재배포금지>

'전문서비스로봇' 카테고리의 다른 글

| 미르, 안전 기능에 대한 티유브이(TüV) 국제 인증 획득 (0) | 2023.06.15 |

|---|---|

| 마로솔, 청소고민 해결 프로젝트 ‘청소특공대’ 사연접수 (0) | 2023.06.15 |

| ABB 로보틱스, 아마존 열대우림 복원한다 (0) | 2023.06.14 |

| "일본 물류업계, 운반 로봇 도입으로 2024년 위기 돌파한다" (0) | 2023.06.14 |

| [창간 10주년 기획] 아바타 로봇과 로봇기술의 미래 (0) | 2023.06.14 |