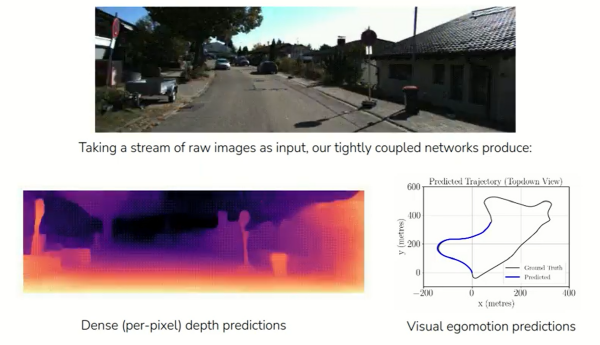

▲ 연구 결과를 도로에서 실증하는 모습(사진=유튜브 갈무리)

캐나다 토론토대 연구팀이 2개의 상이한 유형의 신경망을 결합해 로봇 시스템의 시각적 인식을 향상시킬 수 있는 방법을 찾았다고 밝혔다.

이 혁신적 기술은 자율주행차량이 혼잡한 거리를 이동하거나 의료 로봇이 붐비는 병원 복도에서 효과적으로 작동할 수 있도록 도와준다.

연구팀에 따르면 로봇의 신경망 시스템이 예상대로 작동하지 않을 때 설계자들은 더 많은 매개변수를 추가하는 방식으로 네트워크를 더 크게 만든다. 이에 반해 토론토대 연구팀은 “동작 추정의 2가지 부분(정확한 심도 인식과 동작 인식)이 어떻게 강력한 방식으로 결합될 수 있는지에 관해 연구했다”고 말했다.

연구팀은 그동안 인간이 다양한 작업을 수행하도록 지원하는 신뢰할 수 있는 시스템을 구축하는 것을 연구 목표로 해왔다. 예를 들어, 연구팀은 출입구를 통과하는 것과 같은 몇 가지 일반적인 작업을 자동화할 수 있는 전동 휠체어를 설계했다. 또한 붐비는 병원 복도, 번화한 광장, 자동차와 보행자로 가득한 도시의 거리 등 매우 역동적인 환경에서 로봇과 자율주행 시스템이 상황을 인식하는 기술에 대해 집중적으로 연구했다.

로봇이 마주하는 이 같은 복잡한 환경을 로봇 커뮤니티에선 ‘동작으로부터의 구조’(structure from motion)라고 칭하고 있다. 이는 로봇이 움직이는 카메라에서 촬영한 이미지 세트를 연결해 주변 환경에 대한 3D 모델을 만드는 과정이다. 그 과정은 사람들이 주변 환경을 지각하기 위해 자신의 눈을 사용하는 방식과 유사하다.

오늘날의 로봇 시스템에서 ‘동작으로부터의 구조’ 문제는 일반적으로 두 단계로 성취된다. 하나는 심도(깊이) 인식으로, 로봇에게 시야에 있는 물체들이 얼마나 멀리 떨어져 있는지 알려준다. ‘에고모션’(egomotion)이라고 알려진 다른 하나는 로봇의 환경에 대한 3D 동작을 묘사한다.

연구팀은 "공간을 이동하는 모든 로봇은 정적이고 역동적인 물체가 자신과 얼마나 멀리 떨어져 있는지, 그리고 (로봇의) 동작이 장면을 어떻게 변화시키는지 알아야 한다"고 말한다. 예를 들어 열차가 선로를 따라 이동할 때 창문 밖을 내다보는 승객은 멀리 있는 물체가 느리게 움직이는 것처럼 보이는 반면 근처에 있는 물체들은 빠르게 지나가는 것을 관찰할 수 있다.

문제는 현재 많은 시스템에서 심도추정(depth estimation)이 동작추정(motion estimation)과 분리되어 있다는 것이다. 즉, 2개의 신경망은 정보를 명시적으로 공유하지 않는다. 심도 추정과 동작 추정을 결합하면 일관성이 보장된다는 게 연구팀의 설명이다. 연구팀이 새로 제시한 시스템은 에고모션 예측을 심도 함수로 만들어 시스템의 전반적인 정확성과 신뢰성을 높이는 것이다.

이번 연구는 최근 일본 교토에서 열린 IROS 2022에서 발표됐다. 기존 학습 기반 방법과 비교해 새로운 시스템은 동작 추정의 오류를 약 50%까지 줄일 수 있다고 연구팀은 밝혔다.

장길수 ksjang@irobotnews.com

<저작권자 © 로봇신문사 무단전재 및 재배포금지>

'인공지능' 카테고리의 다른 글

| 국표원, '2022년 산업 인공지능 표준화 포럼' 총회 개최 (0) | 2022.11.10 |

|---|---|

| 체험형 AI 교육기관 ‘LG디스커버리랩 서울’, 12일 개관 (1) | 2022.11.10 |

| LG전자, 전장사업에 AI 검증 플랫폼 구축 (0) | 2022.11.10 |

| '제6회 삼성 AI 포럼’, 8일부터 이틀간 열려 (0) | 2022.11.09 |

| ETRI, 24개 언어 이해하는 음성인식 기술 개발 (0) | 2022.11.04 |